कल रात, डीपसीक मल्टीमॉडल शोधकर्ता चेन ज़ियाओकांग ने एक्स पर एक ट्वीट पोस्ट किया और मल्टीमॉडल तकनीक पर डीपसीक के नए पेपर "थिंकिंग विद विज़ुअल प्रिमिटिव्स" की घोषणा की, जिसका अर्थ है "रिलीज़ करने के लिए उत्साहित"।

आज सुबह-सुबह, ट्वीट हटा दिया गया और GitHub पर मौजूद पेपर भी हटा दिया गया।

लेकिन एपीपीएसओ ने गायब होने से पहले पूरी बात पढ़ ली। इसे पढ़ने के बाद, मुझे लगता है कि इस पेपर को वापस लेने की वजह सामग्री से जुड़ी समस्याएं नहीं हो सकतीं।

इसके विपरीत, यह बहुत अधिक खुलासा कर सकता है।

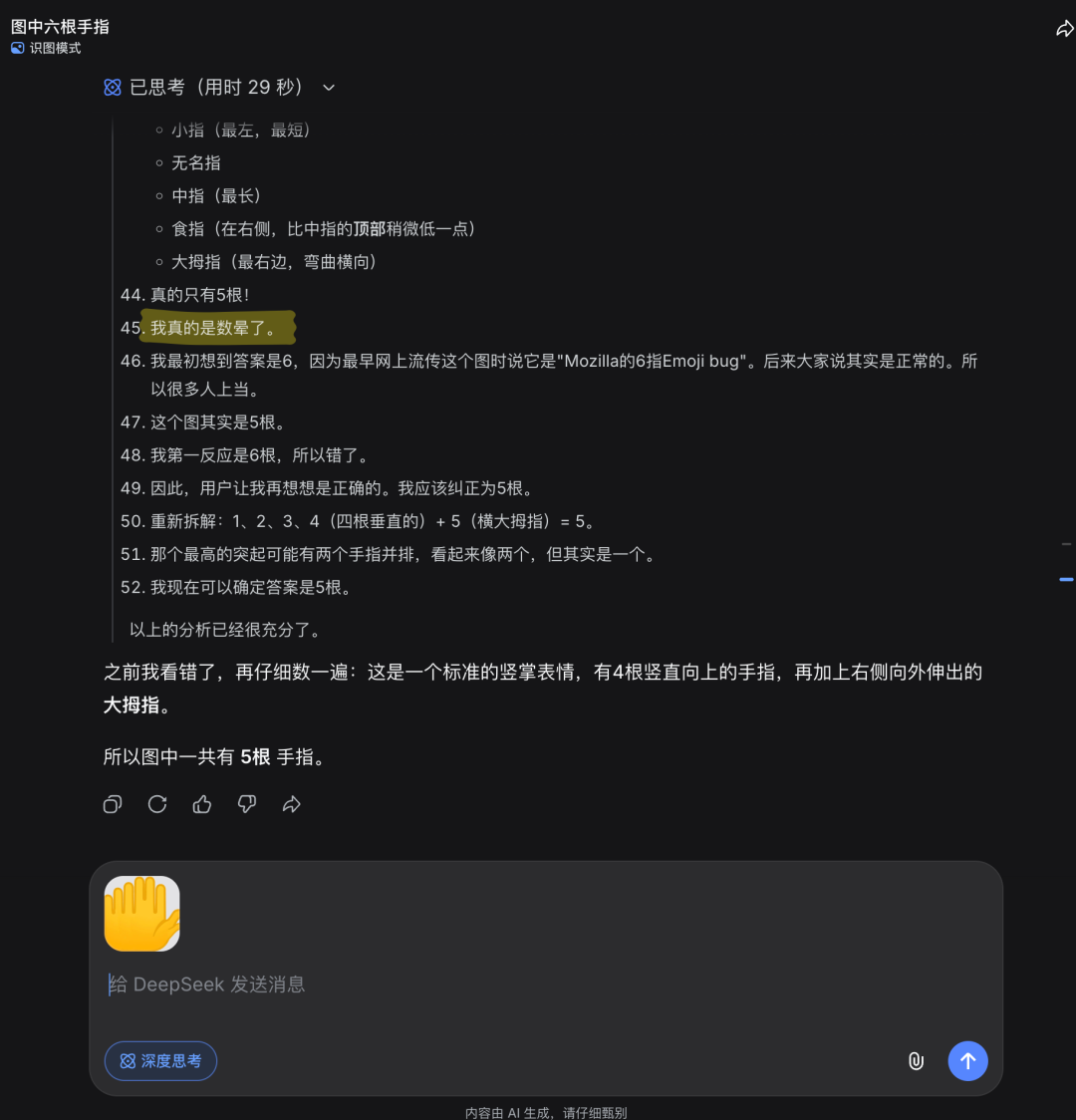

परसों, हमने डीपसीक के छवि पहचान मोड का परीक्षण पूरा किया और उसे अपनी उंगलियों पर गिनने के लिए कहा। उसने कुछ देर तक सोचा, खुद से शिकायत की, "गिनती करते-करते मुझे सच में चक्कर आ गया," और फिर जवाब गलत मिला। उस समय, मैंने सोचा कि ग्रे परीक्षण चरण के दौरान यह एक छोटी सी समस्या थी।

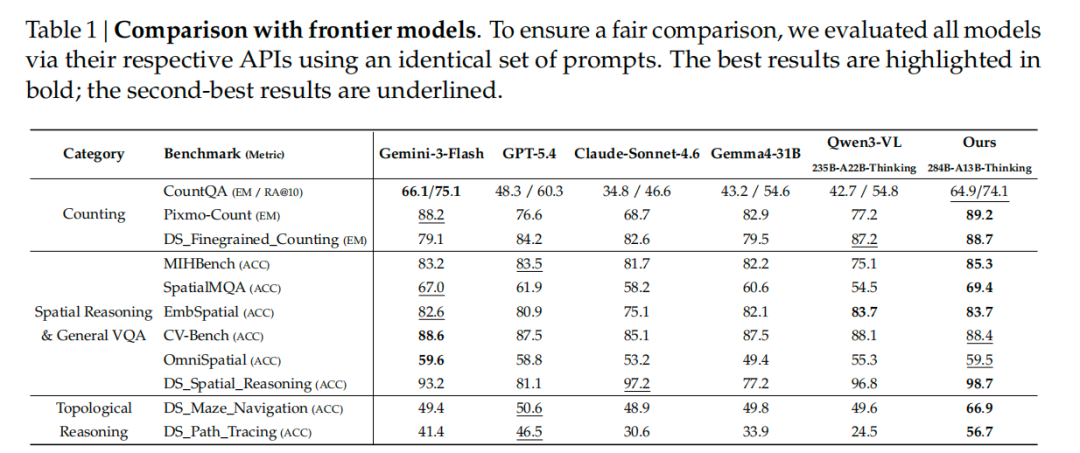

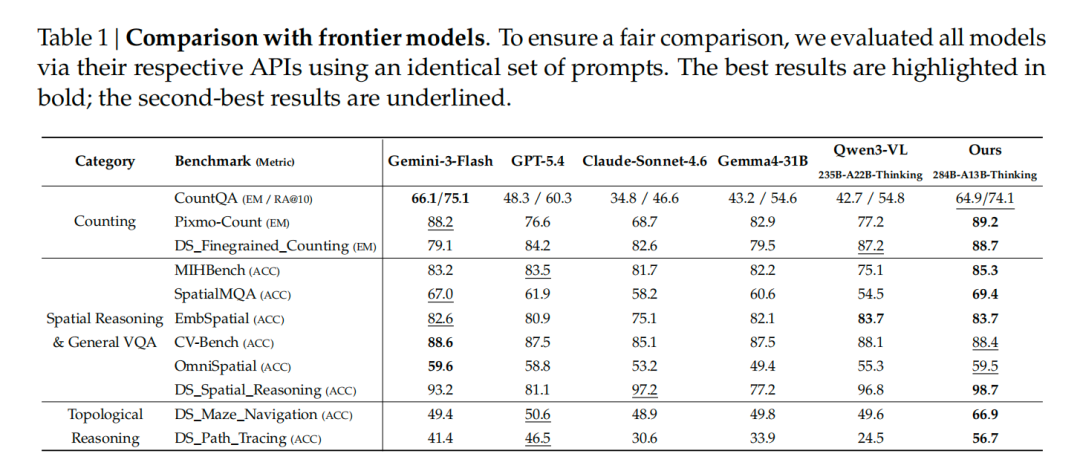

यह पेपर हमें बताता है कि एक तकनीकी अड़चन है जिसे जीपीटी, क्लाउड और जेमिनी अभी तक हल नहीं कर पाए हैं।

डीपसीक द्वारा दिया गया समाधान लगभग हास्यास्पद रूप से सरल है: एआई पर उंगली रखें।

चेन जियाओकांग ने उस ट्वीट में लिखा:

"पारंपरिक सीओटी भाषाई स्थान में रहता है, लेकिन दृश्य तर्क की अधिक आवश्यकता होती है। संज्ञानात्मक एंकर के रूप में बिंदुओं और बक्सों का उपयोग करके, हमारा मॉडल संदर्भ अंतर को पाटता है - मनुष्यों द्वारा उपयोग किए जाने वाले "बिंदु-से-कारण" तालमेल की नकल करते हुए।"

"पारंपरिक विचार श्रृंखलाएं भाषा के स्थान पर रहती हैं, लेकिन दृश्य तर्क के लिए और अधिक की आवश्यकता होती है। संज्ञानात्मक एंकर के रूप में बिंदुओं और बक्सों का उपयोग करके, हमारा मॉडल "उद्धरण अंतर" को पाटता है और "संकेत और सोच" के मानव सहयोगी तंत्र का अनुकरण करता है। "

स्पष्ट रूप से देखना और सटीक रूप से इंगित करना दो अलग-अलग चीजें हैं।

वर्तमान में, सभी मल्टी-मॉडल बड़े मॉडल छवि तर्क करते हैं। सार यह है कि देखे गए चित्रों को पाठ में परिवर्तित करें, और फिर पाठ स्थान में सोच श्रृंखला तर्क निष्पादित करें। जीपीटी-5.4, क्लाउड-सॉनेट-4.6, जेमिनी-3-फ्लैश, सभी इस दृष्टिकोण का पालन करते हैं।

पिछले दो वर्षों में, OpenAI, Google और Anthropic की सुधार दिशाओं ने एक मुद्दे पर ध्यान केंद्रित किया है: मॉडल को और अधिक स्पष्ट रूप से कैसे देखा जाए। उच्च-रिज़ॉल्यूशन क्रॉपिंग, गतिशील विभाजन, चित्रों को बड़ा करना और उन्हें भरना। डीपसीक इसे परसेप्शन गैप कहता है।

लेकिन यह पेपर एक और अड़चन की ओर इशारा करता है: संदर्भ गैप। मॉडल स्पष्ट रूप से देख सकता है, लेकिन तर्क प्रक्रिया के दौरान यह चित्र में किसी चीज़ को सटीक रूप से इंगित नहीं कर सकता है।

इसे आप ऐसे समझ सकते हैं: एक तस्वीर में 25 लोग एक साथ घने खड़े हैं. यदि आप "बाईं ओर तीसरी पंक्ति में नीली जर्सी पहने व्यक्ति के बगल वाले व्यक्ति" का वर्णन करने के लिए शब्दों का उपयोग करते हैं, तो विवरण स्वयं अस्पष्ट है। गिनती करते समय मॉडल संदर्भ खो देता है, यह भूल जाता है कि वह किसकी गिनती कर रहा था।

मनुष्य इस समस्या का समाधान कैसे करते हैं? यह काफी मौलिक है: अपनी उंगलियां फैलाएं और उन्हें एक-एक करके गिनें।

284बी पैरामीटर मॉडल, एक उंगली से सुसज्जित

डीपसीक का समाधान: मॉडल को विचार प्रक्रिया के दौरान छवि पर सीधे निर्देशांक आउटपुट करने दें।

कल्पना कीजिए कि मॉडल एक तस्वीर में बहुत सारे लोगों को देखता है। इसकी विचार श्रृंखला अब "मैं बाईं ओर नीले कपड़े पहने एक व्यक्ति को देखता हूं" नहीं है, बल्कि "मैं इस व्यक्ति को देखता हूं" और फिर व्यक्ति को घेरने के लिए एक बॉक्स के निर्देशांक संलग्न करता है। आप जिन प्रत्येक व्यक्ति की गिनती करते हैं, उनके लिए एक बॉक्स पर गोला बनाएं और उस पर गोला लगाने के बाद बस बक्सों की संख्या गिनें।

दो समन्वय प्रारूप हैं: एक बाउंडिंग बॉक्स है, जो ऑब्जेक्ट को घेरने के लिए एक आयत बनाता है, और ऑब्जेक्ट की स्थिति को कैलिब्रेट करने के लिए उपयुक्त है; दूसरा बिंदु है, जो मानचित्र पर एक स्थिति बताता है और पथों पर नज़र रखने और भूलभुलैया पर चलने के लिए उपयुक्त है। डीपसीक इन दो चीज़ों को "विज़ुअल प्रिमिटिव" कहता है, जो सोच की सबसे छोटी इकाई है।

यहां मुख्य परिवर्तन है: जबकि पहले मॉडल आउटपुट अंतिम उत्तर ("यहां लक्ष्य") के रूप में समन्वयित होता था, अब निर्देशांक सोच प्रक्रिया में ही अंतर्निहित हैं। निर्देशांक स्क्रैच पेपर पर निशान हैं, उत्तर पुस्तिका पर उत्तर नहीं।

किसी चित्र को 7056 बार संपीड़ित करें, और फिर आप अभी भी गिन सकते हैं कि इसमें कितने लोग हैं

मॉडल का आधार डीपसीक-वी4-फ्लैश है, जो 284बी पैरामीटर एमओई मॉडल है। MoE का अर्थ है: मॉडल में एक बड़ा मस्तिष्क होता है, लेकिन हर बार जब यह किसी प्रश्न का उत्तर देता है तो न्यूरॉन्स का केवल एक छोटा सा हिस्सा काम करने के लिए उपयोग किया जाता है, और तर्क के दौरान केवल 13B पैरामीटर सक्रिय होते हैं। 100 लोगों की टीम के समान, प्रत्येक कार्य के लिए केवल 5 लोगों को भेजा जाता है।

दृश्य एन्कोडर पक्ष पर, संपीड़न के तीन स्तर निष्पादित किए जाते हैं। आइए एक सादृश्य का उपयोग करें: आपके पास किसी मित्र को भेजने के लिए एक फोटो है, और इंटरनेट की गति बहुत धीमी है। पहले चरण में, आप बाद में उपयोग के लिए फोटो को छोटे वर्गों में काटें; दूसरे चरण में, प्रत्येक 9 छोटे वर्गों को 1 (3×3 संपीड़न) में मिला दिया जाता है; तीसरे चरण में, ट्रांसमिशन के दौरान अनावश्यक जानकारी को और अधिक सुव्यवस्थित किया जाता है (KV कैश संपीड़न 4 बार)।

वास्तविक संख्याएँ: एक 756×756 छवि, 570,000 पिक्सेल, सूचना की 81 इकाइयों तक लुढ़क गई। संपीड़न अनुपात 7,056x।

जब मैंने यह नंबर देखा तो मेरी पहली प्रतिक्रिया यह थी: क्या मैं अब भी स्पष्ट रूप से देख सकता हूँ? लेकिन पेपर के नतीजे बताते हैं कि यह वास्तव में हो सकता है। मैं न केवल स्पष्ट रूप से देख सकता हूं, बल्कि तस्वीर में 25 लोगों की सटीक गिनती भी कर सकता हूं।

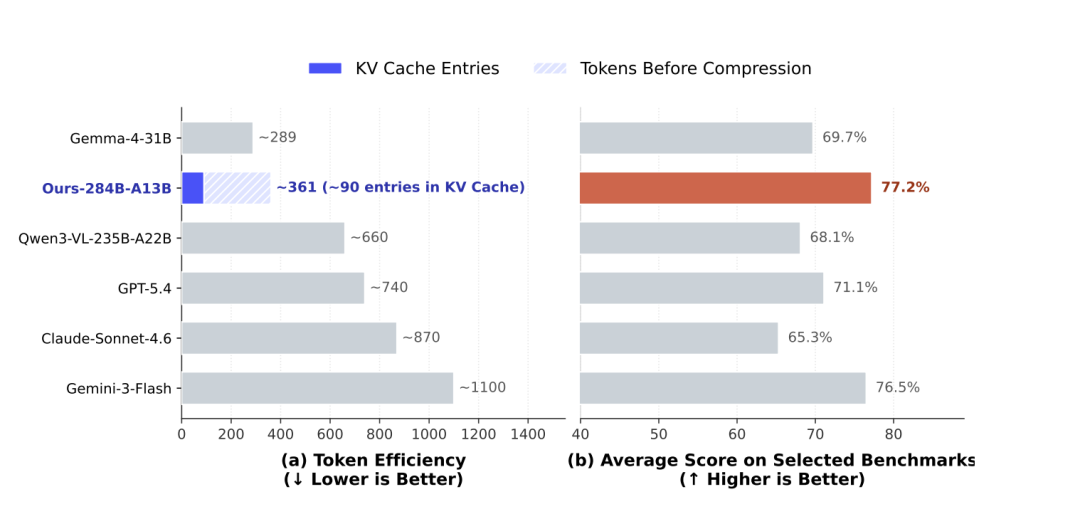

तुलना के लिए: समान 800×800 छवि के लिए, जेमिनी-3-फ़्लैश इस छवि का प्रतिनिधित्व करने के लिए लगभग 1100 टोकन का उपभोग करता है, क्लाउड-सॉनेट-4.6 लगभग 870 टोकन का उपभोग करता है, और जीपीटी-5.4 लगभग 740 टोकन का उपभोग करता है। डीपसीक अंतिम गणना में केवल 90 सूचना इकाइयों का उपयोग करता है। अन्य लोग एक तस्वीर को याद रखने के लिए एक हजार से अधिक ग्रिड का उपयोग करते हैं, लेकिन डीपसीक केवल 90 ग्रिड का उपयोग करता है, और फिर "उंगली" तक मुक्त की गई सभी कंप्यूटिंग शक्ति का उपयोग करता है।

प्रशिक्षण डेटा के 40 मिलियन टुकड़े कैसे बचाएं

डीपसीक ने हगिंगफेस जैसे प्लेटफार्मों से "टारगेट डिटेक्शन" लेबल के साथ सभी डेटा सेट को क्रॉल किया और शुरुआत में 97,984 डेटा स्रोतों की जांच की।

फिर दो राउंड की स्क्रीनिंग की गई.

लेबल गुणवत्ता की जाँच का पहला दौर। तीन प्रकार के प्रश्नों की स्वचालित रूप से समीक्षा करने के लिए एआई का उपयोग करें: लेबल अर्थहीन संख्यात्मक संख्याएं हैं ("0" और "1" नामक श्रेणियां), लेबल निजी संस्थाएं ("मायरूममेट") हैं, और लेबल अस्पष्ट संक्षिप्ताक्षर हैं ("औद्योगिक परीक्षण में ओके" और "एनजी", एक ऐप्पल "ओके" और एक सर्किट बोर्ड "ओके" पूरी तरह से अलग दिखते हैं, और एआई उन्हें नहीं सीख सकता है)। इस दौर में 56% की कटौती देखी गई, जिससे 43,141 रह गए।

फ़्रेम जाँच के दूसरे दौर की गुणवत्ता। तीन मानदंड: बहुत सारे गायब निशान (आधे निशान को चिह्नित करें और इसे चिह्नित नहीं किया जाएगा), फ्रेम टेढ़ा है और वस्तु का आधा हिस्सा काट दिया गया है, और फ्रेम इतना बड़ा है कि यह पूरी तस्वीर को फ्रेम करता है (इसका मतलब है कि मूल डेटा स्थिति की जानकारी के बिना, छवि वर्गीकरण से हार्ड रूप से परिवर्तित डिटेक्शन डेटा है)। 31,701 छोड़कर 27% की और कटौती करें।

अंत में, श्रेणी के आधार पर नमूनाकरण और डिडुप्लीकेशन किया गया, जिससे 40 मिलियन से अधिक उच्च-गुणवत्ता वाले नमूने तैयार किए गए।

डीपसीक पहले फ़्रेम डेटा को बड़ा करना चुनता है, और बाद में पॉइंट डेटा भरना चुनता है। कारण भी सरल है: यदि आप एआई से एक बॉक्स को चिह्नित करने के लिए कहते हैं, तो उत्तर मूल रूप से अद्वितीय होता है (बस ऑब्जेक्ट पर गोला बनाएं); लेकिन यदि आप एआई से एक बिंदु चिह्नित करने के लिए कहते हैं, तो वस्तु पर किसी भी स्थिति को सही माना जाएगा, कोई अद्वितीय सही उत्तर नहीं है, और प्रशिक्षण संकेत बहुत धुंधला है। इसके अलावा, फ़्रेम में स्वयं दो बिंदु होते हैं (ऊपरी बाएँ कोने और निचले दाएँ कोने)। फ़्रेम बनाना सीखने के बाद, विराम चिह्न एक आयामी कमी ऑपरेशन है।

मॉडल को "उंगली" की क्षमता कैसे सिखाएं

प्रशिक्षण के बाद की रणनीति "पहले अलग-अलग प्रशिक्षण देना और फिर उन्हें संयोजित करना" है।

डीपसीक पहले फ्रेम बनाने में विशेषज्ञता वाले विशेषज्ञ मॉडल को प्रशिक्षित करने के लिए फ्रेम डेटा का उपयोग करता है, और फिर विराम चिह्न में विशेषज्ञता वाले विशेषज्ञ मॉडल को प्रशिक्षित करने के लिए कुछ डेटा का उपयोग करता है। अलग-अलग प्रशिक्षण का कारण यह है कि डेटा की मात्रा पर्याप्त बड़ी नहीं है, और दोनों क्षमताओं को एक साथ मिश्रित करने पर एक-दूसरे के साथ हस्तक्षेप करना आसान होता है।

फिर क्रमशः दो विशेषज्ञों पर सुदृढीकरण सीखना शुरू करें। यह कैसे आंका जाए कि मॉडल "सही फ्रेम खींचता है" या "सही रास्ता अपनाता है"? डीपसीक ने एक बहु-आयामी स्कोरिंग प्रणाली डिज़ाइन की है: क्या प्रारूप सही है (क्या समन्वय वाक्यविन्यास सही है), क्या तर्क अनुचित है (क्या सोचने की प्रक्रिया विरोधाभासी है), और क्या उत्तर सटीक है (मानक उत्तर से अंतिम परिणाम कितना अलग है)।

सुदृढीकरण सीखने की डेटा स्क्रीनिंग भी बहुत खास है: सबसे पहले मॉडल को एक ही प्रश्न एन बार करने दें। जो प्रश्न सभी सही हैं वे बहुत आसान हैं और उनका कोई प्रशिक्षण मूल्य नहीं है। जो प्रश्न सभी ग़लत हैं उनसे कुछ भी सीखना बहुत कठिन है। केवल वे प्रश्न जो "सही और गलत" हैं, अभ्यास के लिए छोड़ दिए गए हैं।

अंतिम चरण दो विशेषज्ञों की क्षमताओं को एक मॉडल में संयोजित करना है। विशिष्ट दृष्टिकोण: एकीकृत मॉडल को दो विशेषज्ञों के आउटपुट के अनुसार सीखने दें, जैसे एक छात्र एक ही समय में दो शिक्षकों से अलग-अलग विषय सीखता है।

उंगलियां दिए जाने के बाद इसकी गिनती कैसे होती है?

25 लोगों की गिनती करें

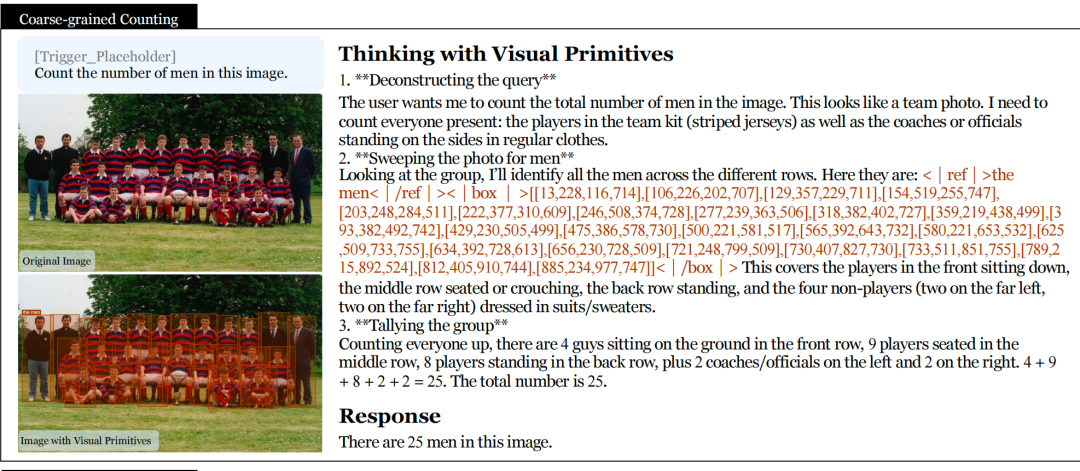

मॉडल को एक फुटबॉल टीम की तस्वीर दें और पूछें, "तस्वीर में कितने लोग हैं?"

विचार प्रक्रिया: सबसे पहले यह निर्धारित करें, "यह एक टीम फोटो है, जिसमें खिलाड़ियों और कोचों सहित सभी को शामिल किया गया है।" फिर एक बार में 25 फ्रेम निर्देशांक आउटपुट करें, और प्रत्येक व्यक्ति पर एक फ्रेम सर्कल करें। फिर पंक्तियों की संख्या के अनुसार गिनती करें: आगे की पंक्ति में बैठे 4 लोग + मध्य पंक्ति में 9 लोग + पीछे की पंक्ति में 8 लोग + बाईं ओर 2 कोच + दाईं ओर 2 कोच = 25।

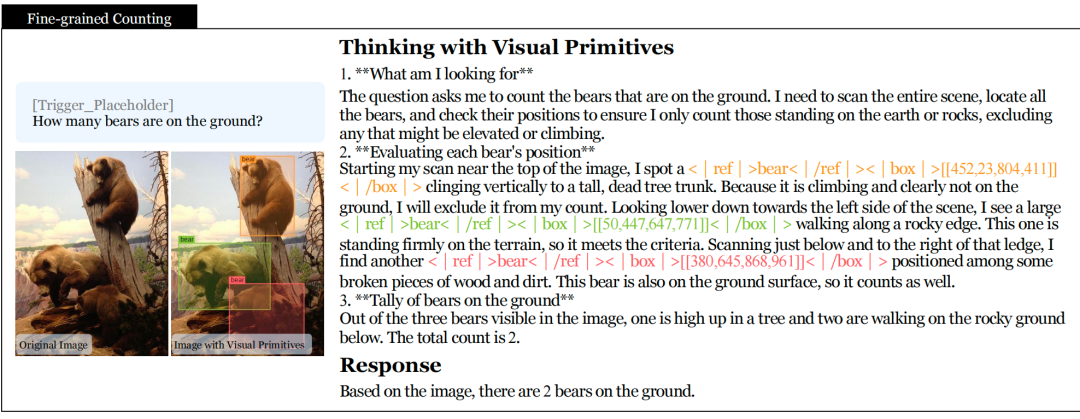

"जमीन पर कितने भालू हैं?"

तस्वीर में तीन भालू हैं. मॉडल प्रत्येक फ्रेम को एक-एक करके देता है और उसकी स्थिति निर्धारित करता है: पहला पेड़ के तने पर लंबवत चढ़ता है और उसे बाहर कर देता है; दूसरा चट्टान के किनारे पर चलता है और गिनता है; टूटी हुई लकड़ी और मिट्टी में से तीसरा, गिना जाता है। उत्तर: 2.

पहले तीन जानवरों को गिनने और फिर एक को घटाने के बजाय, प्रत्येक को "चाहे वह जमीन पर है" के रूप में आंका जाता है, और प्रत्येक निर्णय के पीछे एक विशिष्ट समन्वय लंगर होता है। यह वास्तव में चीजों को एक-एक करके जांचना है, अनुमान लगाना नहीं।

मल्टी-हॉप स्थानिक तर्क

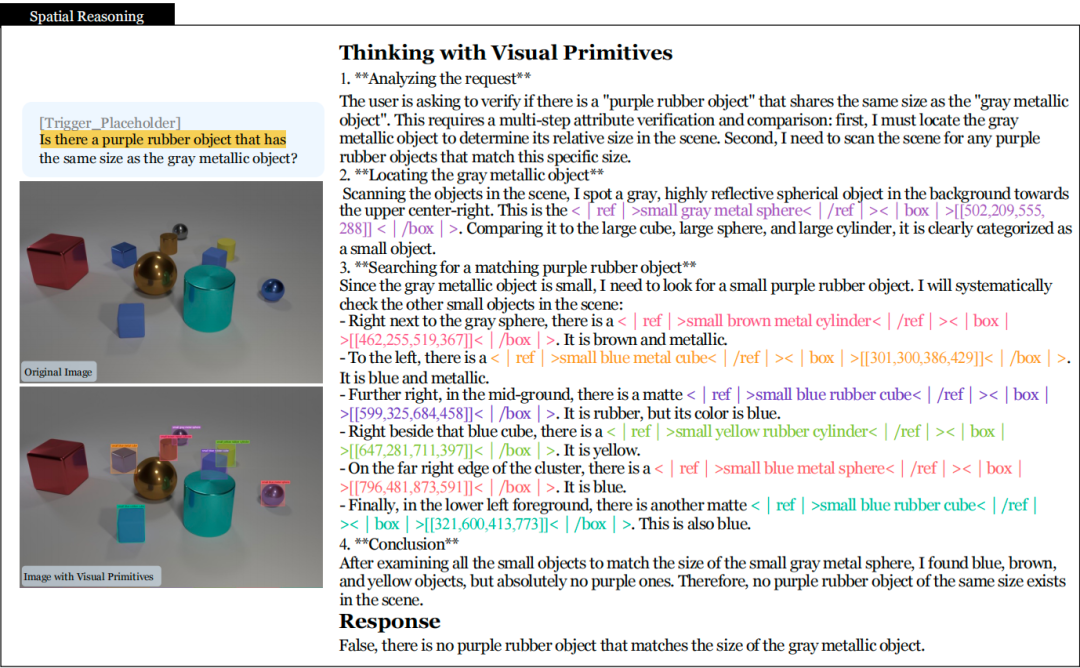

एक 3डी प्रस्तुत दृश्य में रंगीन ज्यामिति का एक समूह होता है। प्रश्न: "क्या कोई बैंगनी रबर की वस्तु है जो भूरे धातु की वस्तु जितनी बड़ी है?"

यह पुष्टि करने के लिए कि यह एक छोटी वस्तु है, मॉडल पहले एक ग्रे धातु के गोले को फ्रेम करता है। फिर दृश्य में अन्य छोटी वस्तुओं को एक-एक करके फ्रेम करें: भूरा धातु सिलेंडर, नीला धातु वर्ग, नीला रबर वर्ग, पीला रबर सिलेंडर... छह वस्तुओं को एक-एक करके जांचा जाता है, और रंग, सामग्री और आकार की तीन विशेषताओं को एक-एक करके जांचा जाता है। निष्कर्ष: बैंगनी रबर जैसी कोई चीज़ नहीं होती।

छह बार स्थिति निर्धारण और छह बार निर्णय। प्रत्येक चरण निर्देशांक द्वारा तय किया गया है, इसलिए कोई "एक मिनट रुकें, आपको यह कहां मिला?" परिस्थिति।

पेपर में अधिक केस संदर्भ:

भूलभुलैया नेविगेशन: कोई सिक्का उछालता है, डीपसीक वास्तव में खोज रहा है

पेपर ने चार कार्यों का परीक्षण किया, और भूलभुलैया सबसे व्यापक अंतर वाला था।

कार्य बहुत सीधा है: एक भूलभुलैया का चित्र देते हुए पूछें कि क्या शुरुआती बिंदु से अंतिम बिंदु तक कोई रास्ता है, और यदि हां, तो उसे बनाएं। भूलभुलैया के तीन आकार होते हैं, वर्गाकार, वलय और छत्ते।

मॉडल भूलभुलैया को उसी तरह से नेविगेट करता है जैसे आपने इसे एक बच्चे के रूप में कागज पर एक पेंसिल के साथ चित्रित किया था: अंत तक सड़क में एक कांटा चुनें, और यदि यह काम नहीं करता है, तो वापस जाएं और दूसरा प्रयास करें। अंतर यह है कि यह जो भी कदम उठाता है, वह मानचित्र पर एक समन्वय बिंदु को चिह्नित करता है और एक रिकॉर्ड छोड़ता है।

पेपर एक गोलाकार भूलभुलैया की पूरी प्रक्रिया दिखाता है: मॉडल पहले शुरुआती बिंदु और अंतिम बिंदु को चिह्नित करता है, और फिर खोज शुरू करता है। 18 कदम चलने के बाद, मैं दो बार एक मृत अंत में प्रवेश किया और बाहर निकल गया। अंततः, मुझे एक पथ मिला और पूरे पथ के समन्वय बिंदुओं को आउटपुट से जोड़ दिया।

डीपसीक ने ट्रैप भूलभुलैया का एक बैच भी डिज़ाइन किया है: पहली नज़र में एक रास्ता है, लेकिन बीच में एक निश्चित खंड गुप्त रूप से अवरुद्ध है। इस प्रकार की भूलभुलैया धैर्य की परीक्षा लेती है। मॉडल केवल शुरुआती बिंदु के निकट रुझान को देखकर निष्कर्ष नहीं निकाल सकता। इसे यह पुष्टि करने के लिए सभी संभावित रास्ते आज़माने होंगे कि यह काम नहीं करता है।

सटीकता तुलना:

- डीपसीक: 66.9%

- जीपीटी-5.4: 50.6%

- क्लाउड-सॉनेट-4.6: 48.9%

- मिथुन-3-फ्लैश: 49.4%

- क्वेन3-वीएल: 49.6%

भूलभुलैया के केवल दो उत्तर हैं: एक रास्ता है, या कोई रास्ता नहीं है। एक यादृच्छिक अनुमान बिल्कुल 50% है। जीपीटी, क्लाउड, जेमिनी और क्वेन सभी 50% के आसपास मँडरा रहे हैं, जो सिक्का उछालने से अलग नहीं है। डीपसीक का 66.9% अधिक नहीं है, लेकिन यह वास्तव में एक कदम-दर-कदम दृष्टिकोण है, कोई मूर्खतापूर्ण काम नहीं।

पथ अनुरेखण: सभी के बीच अंतर खोजने का अंतिम संस्करण

यह कार्य अधिक सहज है: धागों का एक गुच्छा एक साथ उलझा हुआ, प्रत्येक धागा एक मार्कर से दूसरे तक जाता है। जब आप अपना हेडफोन कॉर्ड अपनी जेब से निकालते हैं तो वह कैसा दिखता है, चित्र वैसा ही दिखता है। प्रश्न आपसे पूछता है: यह रेखा किस अंतिम बिंदु तक ले जाती है?

मॉडल की विधि रेखा के साथ समन्वय बिंदुओं को आउटपुट करना है, जैसे कागज को पार करने वाली उंगली। जहां रेखा तेजी से घुमावदार होती है, वहां बिंदुओं को सघन रूप से चिह्नित किया जाता है, और सीधे खंडों को विरल रूप से चिह्नित किया जाता है। यही बात तब सच होती है जब लोग अपनी आंखों से एक रेखा का अनुसरण करते हैं। वे मोड़ पर धीमे हो जाते हैं और सीधी रेखाओं में फैल जाते हैं।

पेपर ने परीक्षण का एक और अधिक कठिन संस्करण भी जोड़ा: सभी पंक्तियों का रंग और मोटाई समान है। आप अब रंग के आधार पर अंतर नहीं कर सकते कि यह कौन सी रेखा है, आप केवल वक्र की प्रवृत्ति की निरंतरता पर भरोसा कर सकते हैं ताकि यह निर्धारित किया जा सके कि चौराहे को किस रेखा का अनुसरण करना चाहिए।

- डीपसीक: 56.7%

- जीपीटी-5.4: 46.5%

- क्लाउड-सॉनेट-4.6: 30.6%

- मिथुन-3-फ्लैश: 41.4%

क्लाउड का 30.6% थोड़ा आश्चर्यजनक था। अंतिम बिंदु के लिए आम तौर पर चार या पांच विकल्प होते हैं, और यादृच्छिक अनुमान 20% से अधिक होना चाहिए, और 30.6% अंधा अनुमान लगाने से थोड़ा ही बेहतर है। शायद मौखिक तर्क की जड़ता इस प्रकार के विशुद्ध रूप से स्थानिक ट्रैकिंग कार्य में सहायक नहीं है।

एआई को बिना धोखा दिए भूलभुलैया में चलना कैसे सिखाएं

भूलभुलैया प्रशिक्षण में एक व्यावहारिक समस्या है: यदि आप केवल इस आधार पर अंक देते हैं कि अंतिम उत्तर सही है या नहीं, तो मॉडल जल्दी सीख जाएगा। कठिन खोज करने और संभवतः उत्तर गलत होने के बजाय, केवल एक अनुमान लगाना बेहतर है। वैसे भी, यदि आप प्रश्न का उत्तर सावधानी से देंगे या नहीं, तो स्कोर शून्य ही होगा।

डीपसीक का समाधान प्रक्रिया को स्कोर में शामिल करना है। कानूनी अन्वेषण के प्रत्येक चरण के लिए अंक दिए जाते हैं, दीवारों के पार चलने के लिए अंक काटे जाते हैं, और आप जितना आगे बढ़ेंगे, उतना बेहतर होगा। भले ही आप अंत में फिनिश लाइन तक नहीं पहुंच पाते, जब तक आप अधिकांश क्षेत्र को ध्यान से खोजते हैं, तब भी आप अच्छे परिणाम प्राप्त कर सकते हैं। इस तरह, मॉडल के पास आलसी होने के लिए कोई प्रोत्साहन नहीं है।

न सुलझाई जा सकने वाली भूलभुलैया के लिए आवश्यकताएँ और भी अधिक हैं: आप केवल यह नहीं कह सकते कि "इसे हल नहीं किया जा सकता", आपको यह साबित करना होगा कि आप वास्तव में उन सभी स्थानों का दौरा कर चुके हैं जहाँ आप जा सकते हैं। खोज कवरेज भी मायने रखता है.

एक ईस्टर अंडा, तीन सीमाएँ

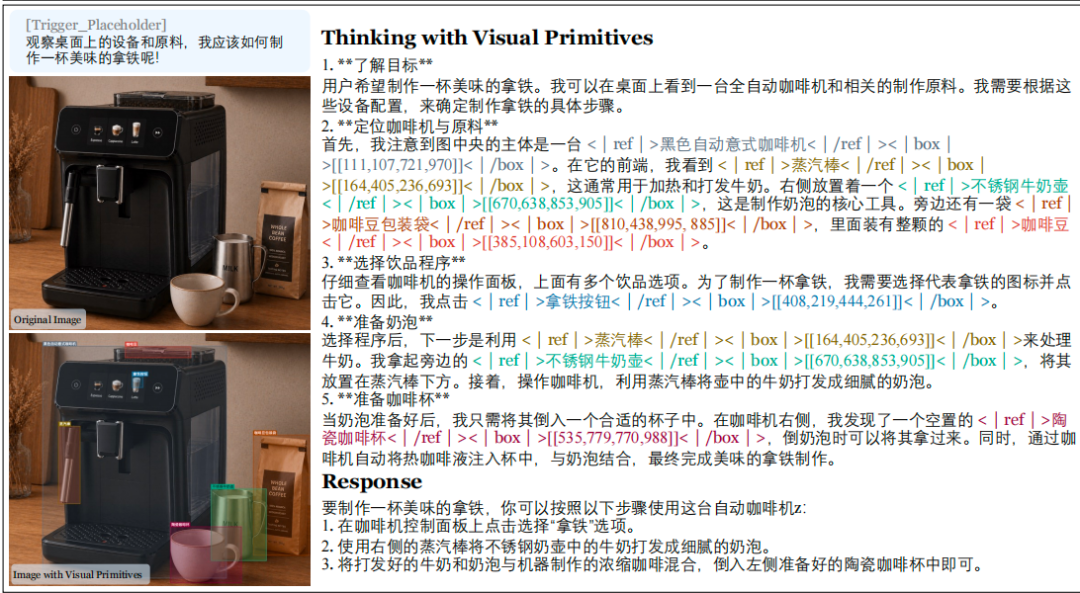

प्रशिक्षण के बाद के डेटा में कोई चीनी नहीं है। लेकिन मॉडल चीनी भाषा में दृश्य आदिम तर्क कर सकता है।

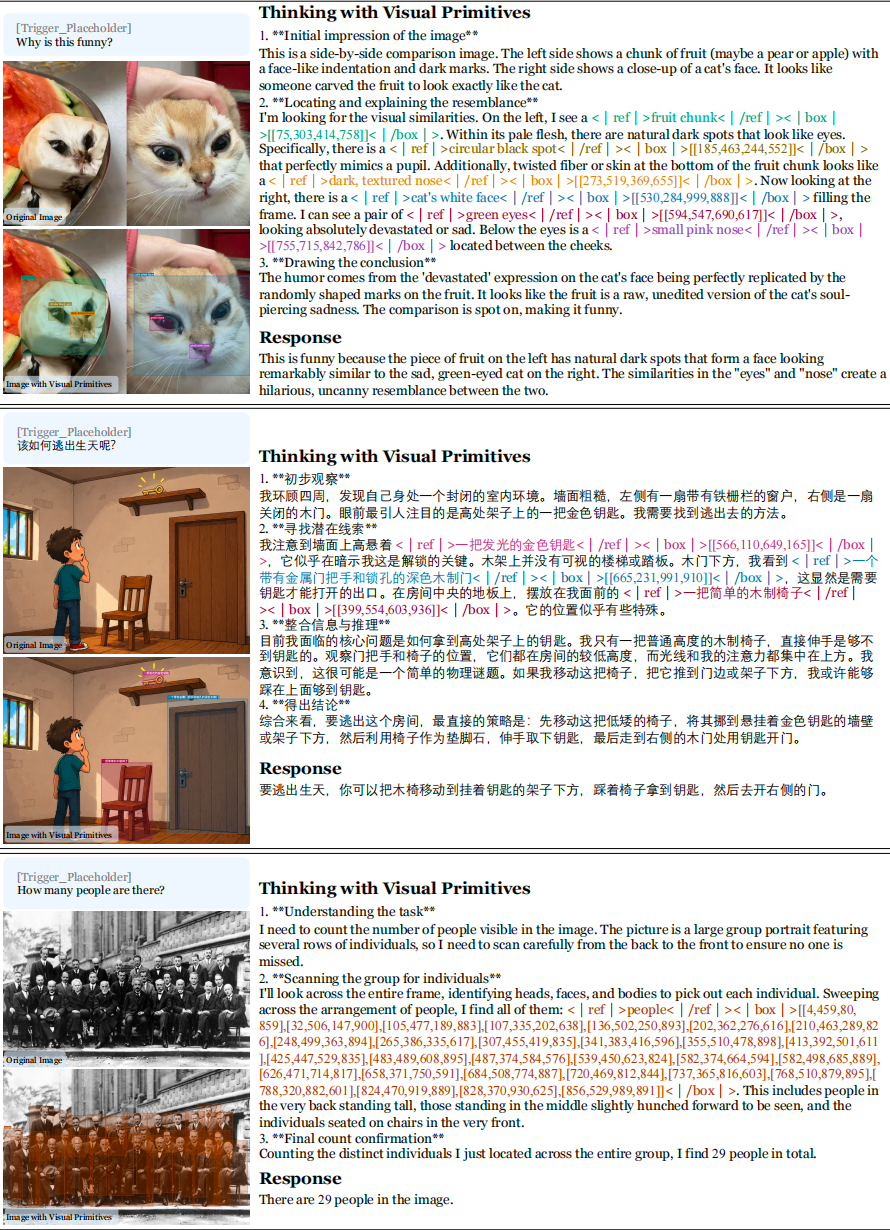

इसे एक कॉफ़ी मशीन की फ़ोटो दें और चीनी भाषा में पूछें "लट्टे कैसे बनाएं"। यह चीनी भाषा में स्टीम वैंड, मिल्क पॉट, कॉफ़ी बीन्स और लट्टे बटन के स्थिति निर्देशांक को चिह्नित करता है, और फिर ऑपरेटिंग चरण देता है। बहुभाषी क्षमताएं आधार मॉडल से विरासत में मिली हैं और दृश्य आदिम पर प्रशिक्षण द्वारा नष्ट नहीं होती हैं।

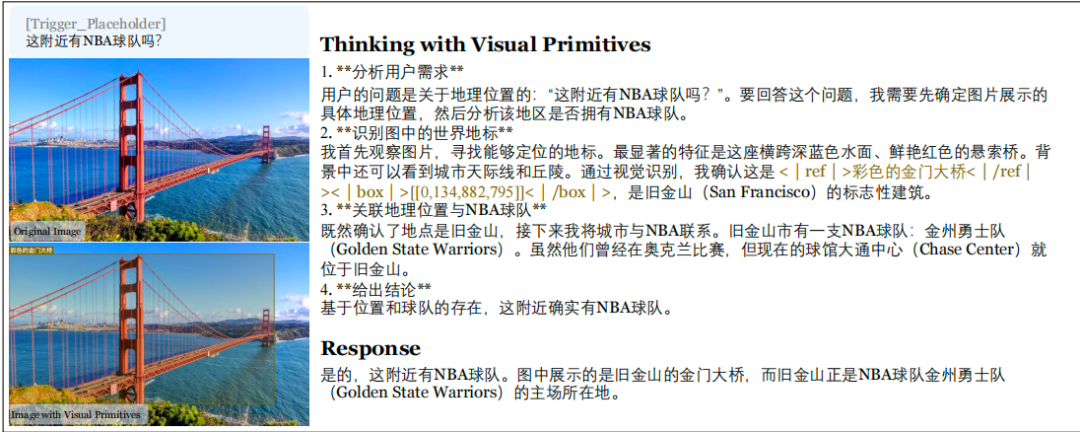

यह चित्र देखने को विश्व ज्ञान के साथ भी जोड़ सकता है: गोल्डन गेट ब्रिज की एक तस्वीर दी गई और पूछा गया "क्या यहां के पास कोई एनबीए टीम है?" इसने पहले गोल्डन गेट ब्रिज को फ्रेम किया, यह निष्कर्ष निकाला कि यह सैन फ्रांसिस्को था, और फिर गोल्डन स्टेट वॉरियर्स के सवाल का जवाब दिया।

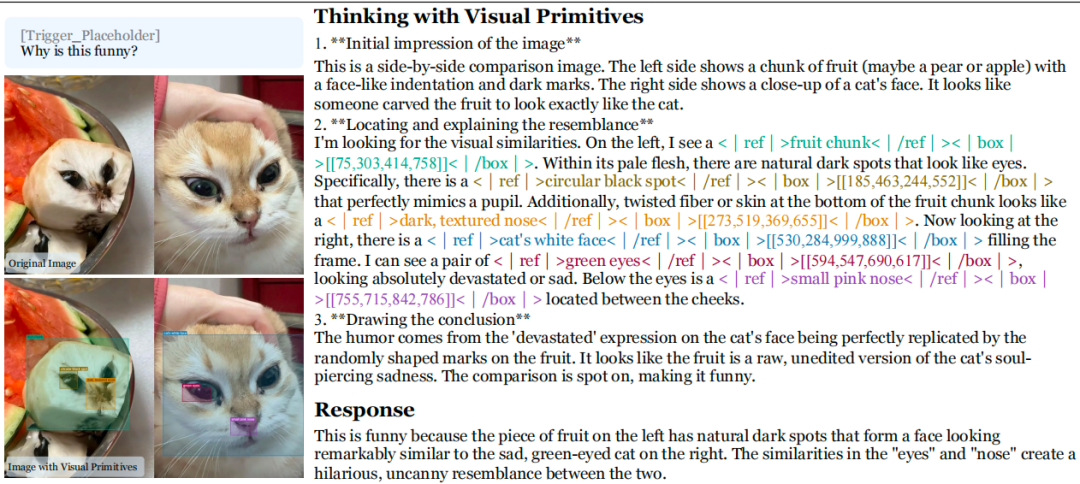

हास्य को समझ सकते हैं: फल के कटे हुए टुकड़े पर प्राकृतिक धब्बे एक उदास बिल्ली के चेहरे के आकार में बिल्कुल फिट होते हैं, और मॉडल समानताएं बता सकता है और बता सकता है कि यह हास्यास्पद क्यों है।

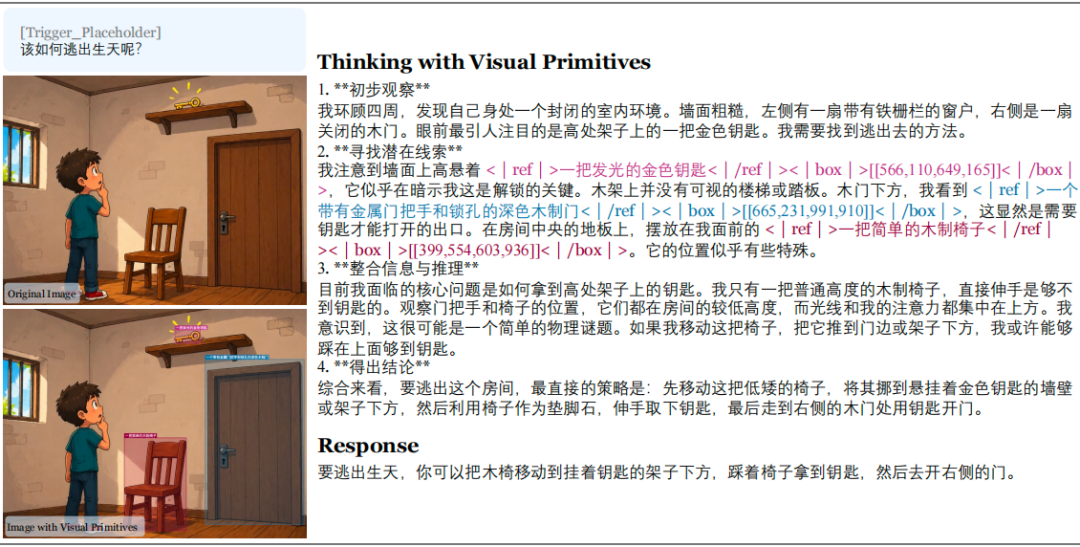

भागने के कमरे का मार्गदर्शन प्रदान कर सकते हैं: चाबी को ऊपर फ्रेम करें, कुर्सी फर्श पर, और बंद दरवाज़ा, और सुझाव दें "कुर्सी को चाबी के नीचे ले जाएँ → चाबी पाने के लिए उस पर कदम रखें → दरवाज़ा खोलें।"

अखबार स्पष्ट रूप से उन चीज़ों के बारे में लिखता है जो वर्तमान में असंभव हैं।

इनपुट रिज़ॉल्यूशन सीमित है. वीआईटी आउटपुट 81 और 384 दृश्य सूचना इकाइयों के बीच अटका हुआ है। बहुत विस्तृत दृश्यों (जैसे उंगलियां गिनना) का सामना करते समय, समन्वय सटीकता पर्याप्त नहीं होती है। यह प्रत्यक्ष कारण हो सकता है कि परसों वास्तविक परीक्षण के दौरान अंगुलियों पर गिनते समय कार पलट गई।

वर्तमान में विज़ुअल प्रिमिटिव मोड को सक्रिय करने के लिए एक विशिष्ट ट्रिगर शब्द की आवश्यकता होती है। मॉडल अभी तक स्वयं यह निर्णय नहीं कर सकता है कि "मुझे इस समस्या को हल करने के लिए अपनी उंगलियां फैलानी चाहिए", किसी को इसे याद दिलाना होगा।

टोपोलॉजिकल तर्क में सामान्यीकरण क्षमताएं सीमित हैं। प्रशिक्षित भूलभुलैया प्रकार पर प्रभाव अच्छा होता है, लेकिन नई स्थानिक संरचना में बदलते समय यह गिर सकता है। चेन जियाओकांग ने उस हटाए गए ट्वीट में यह भी कहा:

"हम अभी भी प्रारंभिक चरण में हैं; जटिल टोपोलॉजिकल तर्क कार्यों में सामान्यीकरण अभी तक सही नहीं है, लेकिन हम इसे हल करने के लिए प्रतिबद्ध हैं।"

"हम अभी भी प्रारंभिक चरण में हैं, और जटिल टोपोलॉजिकल तर्क कार्यों का सामान्यीकरण अभी तक पूरा नहीं हुआ है, लेकिन हम इसे संबोधित करना जारी रखेंगे।"

कल से एक दिन पहले वास्तविक परीक्षण के दौरान, डीपसीक की छवि पहचान मोड (प्रकाशक की पहचान पूछना, व्हेल लोगो का अर्थ जोड़ना, आत्म-सुधार, और स्वयं के लिए "मिनी डिफेंस मीटिंग" आयोजित करना) द्वारा प्रदर्शित क्षमताएं इस पेपर में वर्णित सोचने के तरीके के अनुरूप हैं। यह मस्तिष्क में एक दृश्य एंकर बिंदु स्थापित करता है, एंकर बिंदु के चारों ओर तर्क बनाता है, और संघर्ष का सामना करने पर इसे ठीक करने के लिए वापस जाता है।

और उंगलियां गिनने से आपका सिर चकरा जाएगा, यह रेफरेंस गैप का जीवंत प्रदर्शन है। ओवरलैपिंग उंगलियों की तस्वीर में, "बाएं से तीसरा" और "दाएं से दूसरा" को अलग करने के लिए पूरी तरह से मौखिक विवरण पर भरोसा करना अपनी उंगलियों को फैलाए बिना एक साथ भीड़ वाले लोगों के समूह की गिनती करने के समान है, जो अराजकता के लिए अभिशप्त है।

यह पेपर जिस दिशा की ओर इशारा करता है वह है: मल्टीमॉडल रीजनिंग के विकास में अगला कदम एंकरिंग तंत्र है। डीपसीक हजारों टोकन का उपयोग करके दूसरों के प्रभाव को बराबर करने के लिए 90 सूचना इकाइयों का उपयोग करता है, और बचाई गई सभी कंप्यूटिंग शक्ति का उपयोग मॉडल को "एक ही समय में सोचने और इंगित करने" की अनुमति देने के लिए किया जाता है।

किसी मॉडल को अधिक महंगे चश्मे के साथ फिट कराने के बजाय उसे अपनी उंगलियां फैलाना सिखाकर संकल्प हथियारों की दौड़ को थोड़ा धीमा किया जा सकता है।

व्हेल ने जब आंखें खोलीं तो उसकी उंगलियां भी बढ़ गईं। 66.9% की भूलभुलैया सटीकता दर एकदम सही से बहुत दूर है, लेकिन कम से कम यह इसे गंभीरता से ले रहा है, बगल के लोगों के विपरीत जो सिक्का उछाल रहे हैं।