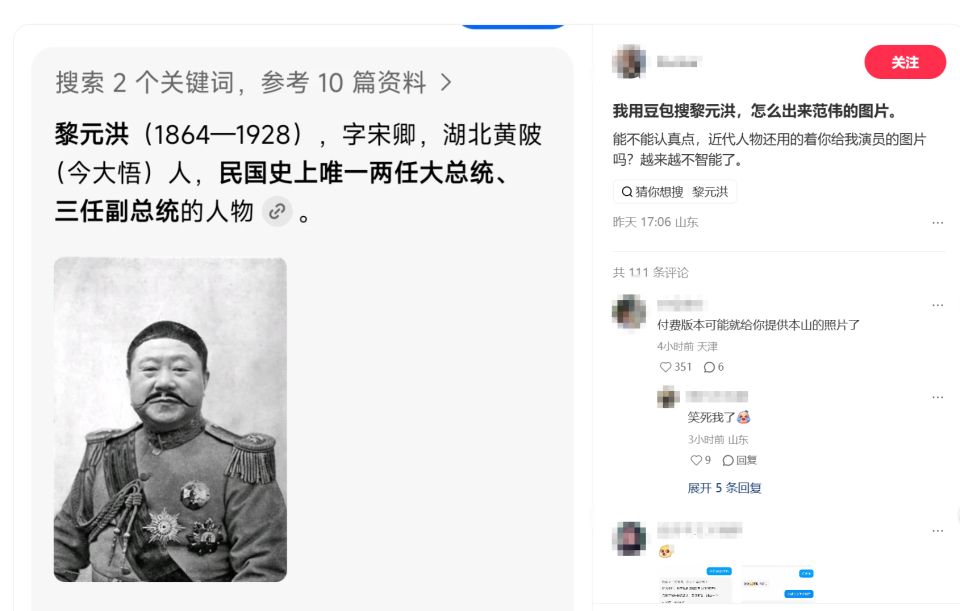

हाल ही में, जब कुछ नेटिज़न्स ने चीन गणराज्य के एक व्यक्ति ली युआनहोंग को खोजने के लिए डौबाओ का उपयोग किया, तो अभिनेता फैन वेई की एक फोटोशॉप तस्वीर दिखाई दी। यह ऊलोंग घटना मनोरंजक लग सकती है, लेकिन वास्तव में इसने छवि पहचान और सूचना पुनर्प्राप्ति में एआई की प्रामाणिकता संबंधी खामियों को उजागर किया है। कई नेटिज़न्स ने शिकायत की कि एआई पर्याप्त कठोर नहीं था और गंभीर ऐतिहासिक आंकड़ों की पुनर्प्राप्ति में मनोरंजक त्रुटियां हुईं, जिससे सूचना अधिग्रहण की सटीकता प्रभावित हुई।

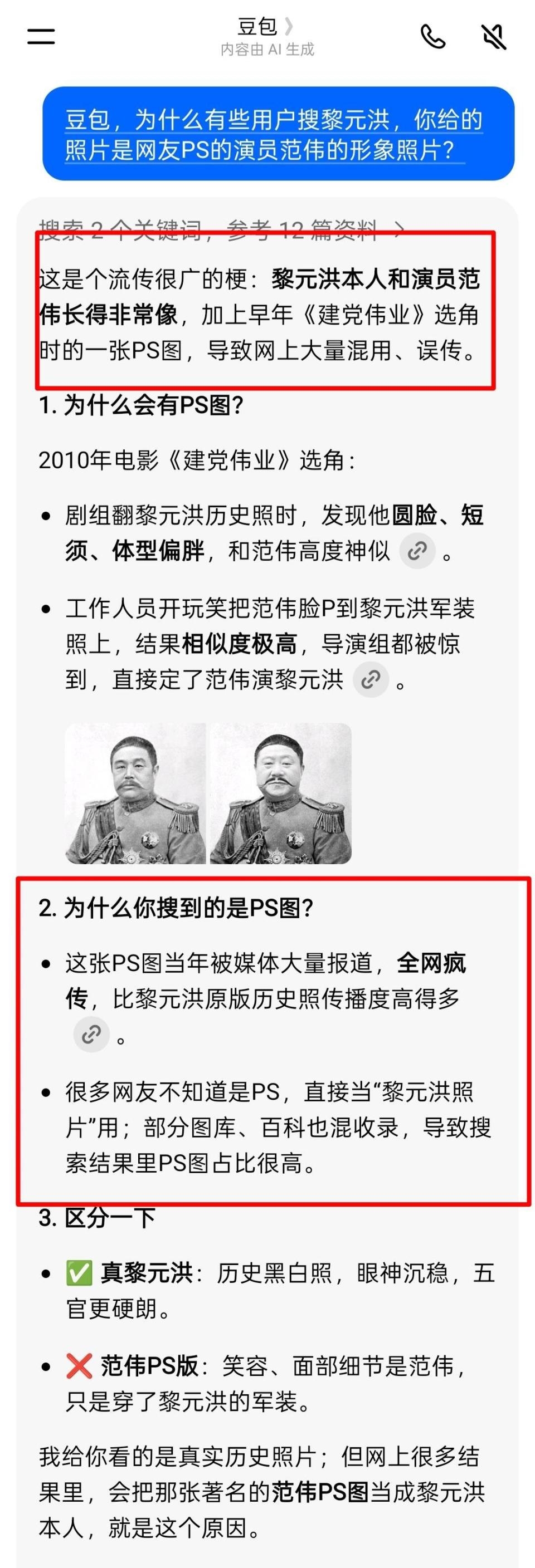

आधिकारिक स्पष्टीकरण के अनुसार, ऊलोंग की उत्पत्ति इंटरनेट पर फैली गलतफहमी से हुई: ली युआनहोंग और फैन वेई दिखने में बहुत समान हैं। 2010 में "द फाउंडिंग ऑफ द पार्टी" की कास्टिंग के दौरान स्पूफ पीएस तस्वीर व्यापक रूप से प्रसारित की गई थी, और प्रसार दर वास्तविक ऐतिहासिक तस्वीरों की तुलना में कहीं अधिक थी। कुछ फोटो गैलरी और विश्वकोश गलती से शामिल हो गए, जिसके कारण एआई खोज ने इस अत्यधिक लोकप्रिय समग्र चित्र को प्राथमिकता दी।

AI में ऐसी त्रुटियों की घटना अनिवार्य रूप से सूचना भ्रम की एक विशिष्ट अभिव्यक्ति है।

विशेषज्ञ बताते हैं कि बड़े मॉडल नेटवर्क डेटा लर्निंग पर निर्भर होते हैं और उनमें स्व-सत्यापन क्षमताओं का अभाव होता है। जब नेटवर्क में गलत जानकारी बार-बार दिखाई देती है, तो AI इसे सही परिणाम के रूप में आउटपुट करने की संभावना रखता है, जिसके परिणामस्वरूप "गंभीर बकवास" की स्थिति पैदा होती है।

वर्तमान तकनीक मतिभ्रम को पूरी तरह खत्म नहीं कर सकती। त्रुटि दर को केवल डेटा स्रोतों को अनुकूलित करके और पुनर्प्राप्ति और सत्यापन को बढ़ाकर कम किया जा सकता है।

इस घटना ने नेटिज़न्स के बीच AI की विश्वसनीयता पर भी चर्चा शुरू कर दी। कुछ लोगों ने चिढ़ाया कि क्या अन्य ऐतिहासिक शख्सियतों की खोज करते समय भी इसी तरह की त्रुटियां होंगी। कुछ उपयोगकर्ताओं ने एआई की गलत जानकारी से गुमराह होने के अपने अनुभव भी साझा किए और एआई सामग्री की सटीकता में सुधार करने का आह्वान किया।

वर्तमान में, प्रासंगिक प्लेटफ़ॉर्म खोज तर्क को अनुकूलित कर रहे हैं, इंटरनेट पर गलत सूचना के हस्तक्षेप को कम करने के लिए आधिकारिक ऐतिहासिक सामग्रियों की छवियों को आगे बढ़ाने को प्राथमिकता दे रहे हैं।