आधुनिक एआई छवि जनरेटर तेजी से विकसित हो रहे हैं, और जो खामियां शुरुआती दिनों में एक नज़र में दिखाई देती थीं - जैसे विकृत हाथ और पैर, गन्दा पाठ और अजीब चित्र शोर - धीरे-धीरे इंजीनियरिंग के माध्यम से दूर किए जा रहे हैं। आजकल, कई सिंथेटिक छवियां आम लोगों की नग्न आंखों को धोखा देने और सोशल मीडिया पर अनियंत्रित रूप से फैलने के लिए पर्याप्त हैं। हालाँकि, जर्नल साइंस में प्रकाशित एक अध्ययन बताता है कि ये मॉडल अभी भी अनिवार्य रूप से "समझ में नहीं आते" हैं कि वास्तविक दुनिया में प्रकाश और ज्यामिति कैसे काम करते हैं, और भौतिक कानून प्रामाणिक और नकली छवियों की पहचान करने के लिए सबसे विश्वसनीय उपकरणों में से एक बन रहे हैं।

शोधकर्ताओं ने बताया कि जब तक प्रतिबिंब, छाया, परिप्रेक्ष्य रेखा और अन्य प्रतीत होने वाले तुच्छ भागों को मापा जाता है, तब भी एक प्रतीत होता है कि सही AI फोटो प्रकट करने का मौका है। भौतिक दुनिया की स्थिरता पर आधारित इस सत्यापन पद्धति को डिजिटल फोरेंसिक विशेषज्ञों द्वारा "डीप फेक" के युग में एआई जालसाजी से वास्तविक तस्वीरों को अलग करने में रक्षा की एक महत्वपूर्ण पंक्ति के रूप में माना जाता है। प्रारंभिक पहचान अक्सर किसी न किसी तकनीकी खामियों को पकड़ने के लिए नग्न आंखों पर निर्भर करती थी, लेकिन जैसे-जैसे उत्पादन की गुणवत्ता में सुधार हुआ, छवियां तेजी से "वास्तविकता" की मानवीय व्यक्तिपरक अपेक्षाओं के अनुरूप होने लगीं - चमकीले रंग, नाटकीय रचनाएं और सिनेमाई अनुभव से भरपूर। इस "निर्मित नाटक" ने लोगों के लिए अपनी सतर्कता को कम करना आसान बना दिया।

हनी फरीद, कैलिफोर्निया विश्वविद्यालय, बर्कले में प्रोफेसर और व्यापक रूप से डिजिटल फोरेंसिक के क्षेत्र के संस्थापकों में से एक माने जाते हैं, एआई छवियों की एक और "छिपी कमजोरी" का फायदा उठा रहे हैं। उनका दृष्टिकोण स्पष्ट दृश्य त्रुटियों की तलाश करना नहीं है, बल्कि उत्पन्न छवियों की तुलना उन ज्यामितीय संबंधों से करना है जो वास्तविक दुनिया में दिखाई देने चाहिए। उनकी राय में, मौजूदा छवि निर्माण मॉडल ने अभी तक कला वर्ग में मूल अवधारणा - लुप्त बिंदु को नहीं सीखा है।

उदाहरण के तौर पर "गलियारे में मार्च करते सैनिकों" की AI-जनित तस्वीर लें। आप तस्वीर में कुछ स्पष्ट खामियां देख सकते हैं, जैसे दीवार पर धुंधला और पढ़ने में मुश्किल पाठ, अस्पष्ट जंजीरें आदि। लेकिन अधिक महत्वपूर्ण सुराग जमीन पर टाइलों में छिपा है: परिप्रेक्ष्य के सिद्धांत के अनुसार, वास्तविकता में समानांतर रेखाएं (जैसे कि फर्श टाइल्स और लकड़ी के फर्श के सीम) को चित्र में उसी लुप्त बिंदु तक विस्तारित और परिवर्तित होना चाहिए। यदि आप लाइन टूल के साथ इन संरचनाओं के साथ रेखाएं खींचते हैं, तो आप यह देखने के लिए जांच कर सकते हैं कि क्या वे वास्तविक तस्वीर की तरह दूरी में मिलते हैं, जिससे आपको प्रारंभिक समझ मिल जाएगी कि छवि भरोसेमंद है या नहीं।

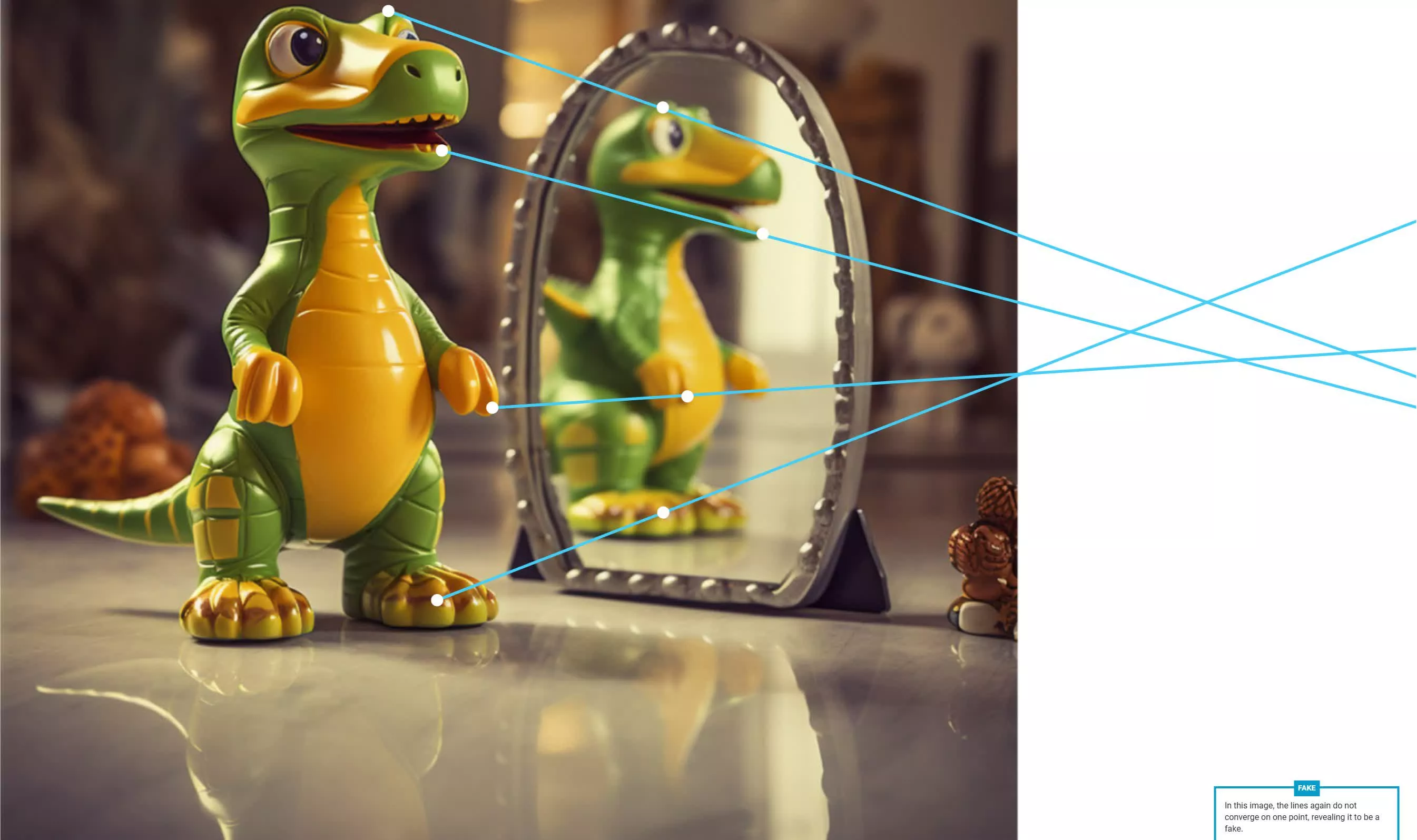

समान ज्यामितीय संबंध प्रतिबिंबों पर भी लागू होते हैं। शोध बताते हैं कि यद्यपि आज के जेनरेटिव मॉडल पहले से ही पानी या स्पेक्युलर प्रतिबिंबों को संश्लेषित कर सकते हैं जो मानव आंखों को बेवकूफ बनाने के लिए पर्याप्त हैं, जब तक आप उन्हें मापने के लिए एक शासक लेते हैं तब तक समस्याएं उजागर हो जाएंगी। वास्तविक दुनिया में, किसी वस्तु के एक निश्चित बिंदु और प्रतिबिंब में उसके संबंधित बिंदु को जोड़ने वाली रेखाएं एक दूसरे के समानांतर होनी चाहिए और विस्तारित होने के बाद उसी लुप्त बिंदु की ओर इशारा करना चाहिए; एक बार जब इन रेखाओं में अनुचित विचलन दिखाई देने लगे, तो इसका अर्थ यह हो सकता है कि यह एक मिश्रित छवि है।

सूर्य द्वारा डाली गई छाया भी इस प्रकार के परीक्षण के लिए अतिरिक्त पकड़ प्रदान करती है। चूंकि सूर्य पृथ्वी से बहुत दूर है, इसलिए मोटे तौर पर यह माना जा सकता है कि जमीन से टकराने वाला सूर्य का प्रकाश समानांतर प्रकाश है। इस आधार के तहत, वस्तु के एक निश्चित बिंदु और छाया में उसके संबंधित बिंदु के बीच की रेखा को भी बढ़ाया जा सकता है और एक लुप्त बिंदु पर अभिसरण किया जा सकता है। यदि किसी तस्वीर में विभिन्न वस्तुओं की छाया रेखाएं एक सुसंगत ज्यामितीय संबंध को इंगित नहीं कर सकती हैं, तो यह प्रकाशिकी के बुनियादी नियमों का उल्लंघन होने की संभावना है।

वर्तमान में यह अनुमान लगाना कठिन है कि कब और क्या जनरेटिव मॉडल इन भौतिकी-स्तर की त्रुटियों को मौलिक रूप से दूर करेंगे। शुरुआती दिनों में नंगी आंखों से आसानी से पहचानी जाने वाली खामियों की तुलना में, परिप्रेक्ष्य और प्रकाश पर आधारित "ज्यामितीय सत्यापन" के लिए पर्यवेक्षकों को अधिक समय और ऊर्जा खर्च करने की आवश्यकता होती है, जो औसत सोशल मीडिया उपयोगकर्ता की दैनिक सतर्कता सीमा से कहीं अधिक है। कुछ शोधकर्ताओं का यह भी मानना है कि ऐसे भौतिक नियमों की गहरी समझ वर्तमान मुख्यधारा जेनरेटर मॉडल की डिजाइन क्षमताओं से परे हो सकती है।

इस काम के अलावा, विशेषज्ञ उपयोगकर्ताओं को "एआई की पहचान करने के लिए एआई का उपयोग करने" के बारे में सतर्क रहने की भी याद दिलाते हैं। कुछ शर्तों के तहत कुछ स्वचालित पहचान उपकरण वास्तव में अप्रशिक्षित मानव आंख की तुलना में अधिक विश्वसनीय हो सकते हैं, लेकिन एक बार इनपुट छवि और उसके प्रशिक्षण डेटा का वितरण बहुत अलग हो जाता है, तो एल्गोरिदम त्रुटियों और यहां तक कि व्यवस्थित पूर्वाग्रहों से ग्रस्त हो जाएगा। दूसरे शब्दों में, स्क्रीनिंग कार्य को पूरी तरह से किसी अन्य ब्लैक बॉक्स मॉडल को सौंपना कोई अचूक समाधान नहीं है।

एक संबंधित अध्ययन ने एक दिलचस्प खोज भी की: यह पुष्टि करना कि कोई तस्वीर "असली" है, "नकली" की पहचान करने से अधिक कठिन हो सकती है। अध्ययन में पाया गया कि कोई दर्शक किसी छवि को बिना किसी दोष के जितनी देर तक देखता है, उतनी ही अधिक संभावना होती है कि वह वास्तविक तस्वीर है। इस दृष्टिकोण से, "कोई त्रुटि नहीं मिली" ही प्रामाणिकता के प्रमाणों में से एक बन सकता है।