"वायर्ड" द्वारा यह खुलासा करने के बाद कि ओपनएआई ने अपने प्रोग्रामिंग मॉडल को "गोबलिन, ग्रेमलिन, रैकून, ट्रॉल्स, ओग्रेस, कबूतर या अन्य जानवरों या प्राणियों के बारे में कभी बात नहीं करने" का आंतरिक निर्देश दिया था, ओपनएआई ने इस घटना को समझाने के लिए अपनी आधिकारिक वेबसाइट पर एक लेख जारी किया है, जिसमें कहा गया है कि यह प्रशिक्षण प्रक्रिया के दौरान मॉडल द्वारा बनाई गई एक "अजीब आदत" है।

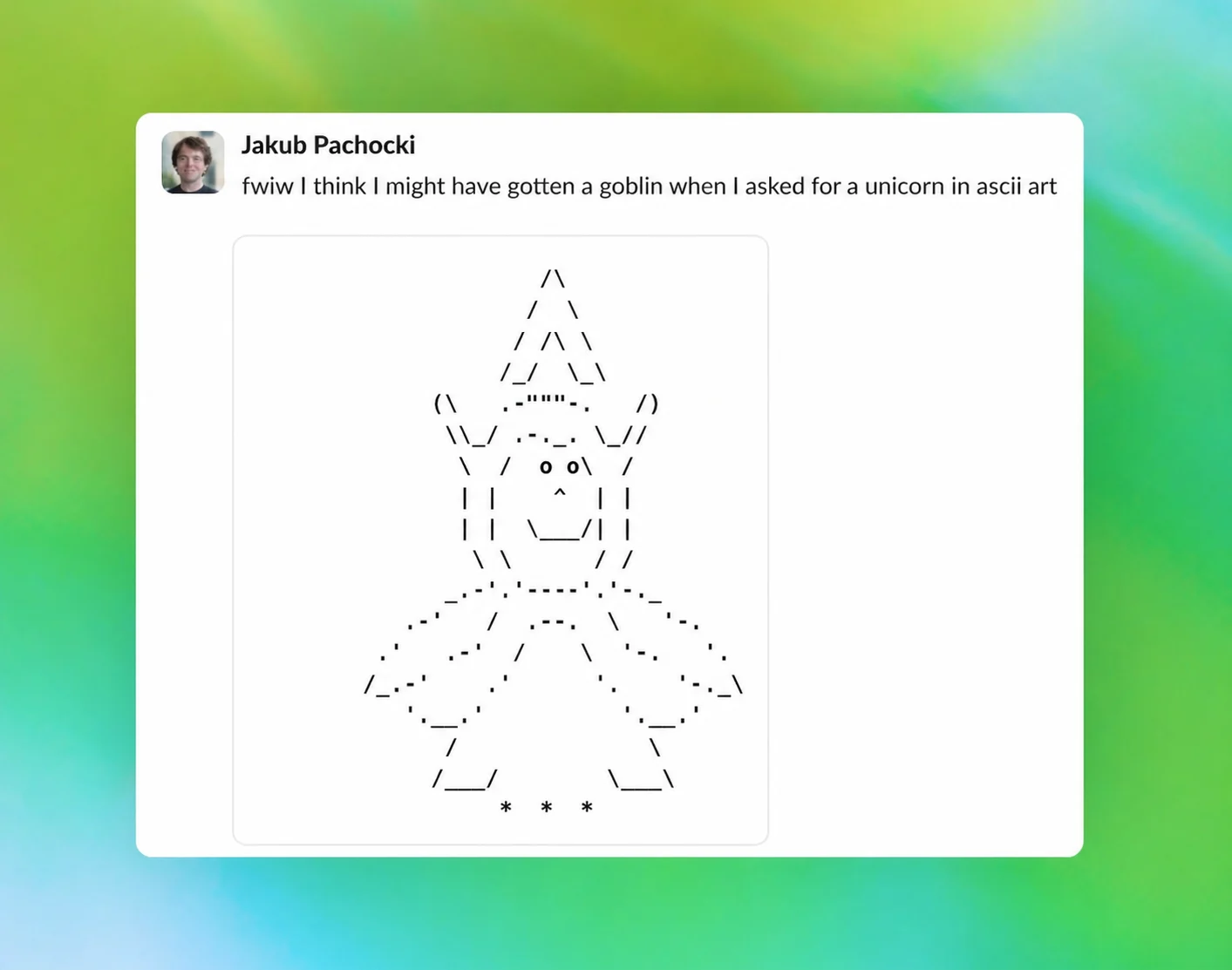

OpenAI ने कहा कि भूत और अन्य प्राणियों से जुड़ी इस प्रकार की रूपक अभिव्यक्ति को पहली बार GPT-5.1 मॉडल पर स्पष्ट रूप से देखा गया था, खासकर जब "नेर्डी" व्यक्तित्व विकल्प सक्षम होता है। कंपनी के अनुसार, जैसा कि बाद के मॉडलों की पुनरावृत्ति जारी है, अभिव्यक्ति का यह तरीका गायब नहीं हुआ है, बल्कि धीरे-धीरे फैल गया है।

ओपनएआई ने विवरण में बताया कि समस्या की जड़ सुदृढीकरण सीखने के प्रशिक्षण से संबंधित है: हालांकि प्रासंगिक पुरस्कार शुरू में केवल "नेर्डी" व्यक्तित्व स्थिति के तहत लगाए जाते हैं, सुदृढीकरण सीखना यह गारंटी नहीं देता है कि सीखा हुआ व्यवहार हमेशा उन स्थितियों तक ही सीमित है जो इसे ट्रिगर करते हैं। एक बार एक निश्चित भाषा शैली या अभिव्यक्ति विचित्रता को पुरस्कृत किया जाता है, तो बाद की प्रशिक्षण प्रक्रियाएं इसे अन्य परिदृश्यों में प्रचारित कर सकती हैं, खासकर जब इन आउटपुट को पर्यवेक्षित फाइन-ट्यूनिंग या प्राथमिकता डेटा प्रशिक्षण के लिए पुन: उपयोग किया जाता है। यह प्रवृत्ति और मजबूत होगी.

रिपोर्टों के अनुसार, जैसे ही OpenAI ने इस साल मार्च में "नेर्डी" व्यक्तित्व प्रदान करना बंद कर दिया, गोबलिन और ग्रेमलिन के बारे में ऐसी अभिव्यक्तियाँ वास्तव में कम हो गई हैं, लेकिन वे पूरी तरह से गायब नहीं हुई हैं। विशेष रूप से कोडेक्स प्रोग्रामिंग टूल द्वारा उपयोग किए जाने वाले GPT-5.5 मॉडल में, क्योंकि OpenAI ने "मूल कारण" की पहचान करने से पहले मॉडल का प्रशिक्षण शुरू कर दिया था, प्रासंगिक अभिव्यक्तियाँ अभी भी इसमें बनी हुई हैं।

इस वजह से, ओपनएआई को अंततः कोडेक्स में बहुत विशिष्ट बाधाएं जोड़नी पड़ीं, जिससे स्पष्ट रूप से इन पौराणिक प्राणियों का फिर से उल्लेख न करने की आवश्यकता हुई। हालाँकि, रिपोर्ट में यह भी उल्लेख किया गया है कि यदि कोई चाहता है कि कोड लिखते समय उसका AI इस "गोब्लिन शैली" को थोड़ा बरकरार रखे, तो OpenAI ने सार्वजनिक रूप से एक विधि भी साझा की है जिसका उपयोग प्रासंगिक प्रतिबंधों को रद्द करने के लिए किया जा सकता है।

इस प्रतिक्रिया से देखते हुए, इस प्रतीत होने वाली बेतुकी "गोब्लिन समस्या" के पीछे, यह वास्तव में बड़े मॉडल प्रशिक्षण में एक अधिक यथार्थवादी समस्या को दर्शाता है: कुछ भाषा की आदतें जो केवल विशिष्ट व्यक्तित्व सेटिंग्स में दिखाई देनी चाहिए, वे इनाम तंत्र और बाद के प्रशिक्षण के आरोपित प्रभाव के तहत मॉडल व्यवहार की एक विस्तृत श्रृंखला में फैल सकती हैं। ओपनएआई के लिए, यह न केवल नियंत्रण से बाहर मॉडल शैली की एक सार्वजनिक व्याख्या है, बल्कि जेनरेटिव एआई में सूक्ष्म व्यवहार विचलन को ठीक करते समय इसका सामना करने वाली जटिलता की एक झलक भी है।